向量数据库 Milvus 实战教程:从入门到生产部署

向量数据库是 AI 时代的基础设施,Milvus 作为全球最流行的开源向量数据库,已服务超过 1000 家企业。本文将从核心概念讲起,手把手带你完成环境搭建、数据操作、性能调优和生产部署,打造企业级向量检索服务。

一、向量数据库:AI 时代的搜索引擎

在传统数据库中,我们用 SQL 查询精确匹配的数据。但在 AI 应用中,我们需要的是「语义相似性搜索」——找到与查询意图最接近的内容,而非字面匹配。

典型应用场景:

- RAG(检索增强生成):让大模型基于私有知识库回答问题,解决幻觉问题

- 语义搜索:搜索「如何学习编程」能匹配到「编程入门指南」

- 推荐系统:基于用户行为向量找到相似用户或商品

- 图像检索:以图搜图,找相似图片

- 异常检测:识别偏离正常模式的异常数据

向量数据库的核心价值:将非结构化数据(文本、图片、音频)转化为向量,支持高效的相似性检索。

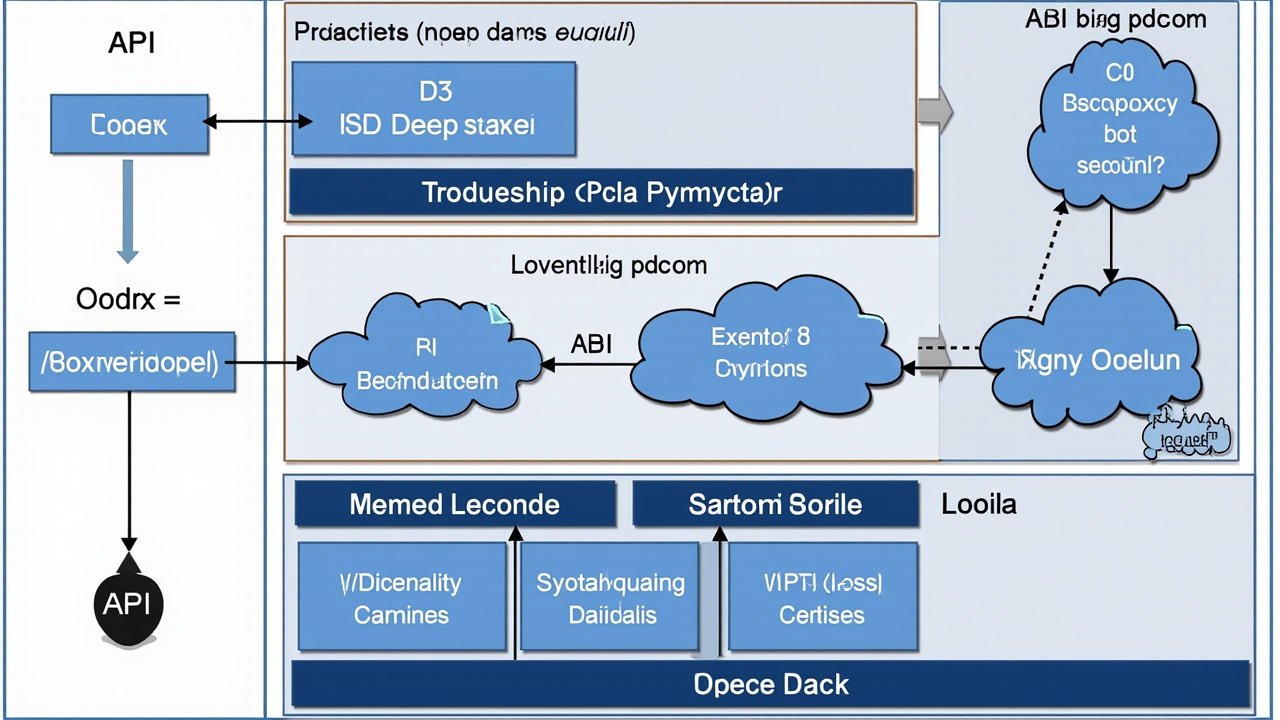

二、Milvus 核心概念详解

Milvus 是一款云原生向量数据库,支持海量向量的存储、索引和检索。理解以下概念是掌握 Milvus 的关键:

2.1 Collection(集合)

Collection 类似关系数据库中的「表」,是存储向量的容器。每个 Collection 包含:

- Schema:定义字段结构(向量维度、数据类型等)

- 向量字段:存储嵌入向量(如 768 维、1536 维)

- 标量字段:存储元数据(如 ID、标题、分类等)

2.2 Index(索引)

索引决定了检索的速度和精度。Milvus 支持多种索引类型:

| 索引类型 | 特点 | 适用场景 |

|---|---|---|

| FLAT | 暴力搜索,精度最高 | 小规模数据(<10万) |

| IVF_FLAT | 聚类分桶,平衡速度精度 | 中等规模,通用场景 |

| IVF_PQ | 量化压缩,内存占用低 | 超大规模,内存受限 |

| HNSW | 图索引,查询速度最快 | 实时性要求高 |

| ANNOY | 树索引,适合静态数据 | 读多写少场景 |

2.3 相似度度量

计算向量相似度的方法:

- L2(欧氏距离):向量间的直线距离,越小越相似

- IP(内积):向量点积,越大越相似,适合归一化向量

- COSINE(余弦相似度):向量夹角余弦值,适合文本语义搜索

2.4 分片与分区

- 分片(Shard):水平切分数据,提升写入并发

- 分区(Partition):逻辑划分数据,加速查询(如按日期分区)

三、环境搭建:Docker 一键部署

Milvus 提供 Standalone(单机)和 Cluster(集群)两种部署模式。开发测试用 Standalone 即可:

3.1 Docker Compose 部署

# docker-compose.yml

version: '3.5'

services:

etcd:

container_name: milvus-etcd

image: quay.io/coreos/etcd:v3.5.5

environment:

- ETCD_AUTO_COMPACTION_MODE=revision

- ETCD_AUTO_COMPACTION_RETENTION=1000

- ETCD_QUOTA_BACKEND_BYTES=4294967296

volumes:

- ./volumes/etcd:/etcd

command: etcd -advertise-client-urls=http://127.0.0.1:2379 -listen-client-urls http://0.0.0.0:2379 --data-dir /etcd

minio:

container_name: milvus-minio

image: minio/minio:RELEASE.2023-03-20T20-16-18Z

environment:

MINIO_ACCESS_KEY: minioadmin

MINIO_SECRET_KEY: minioadmin

volumes:

- ./volumes/minio:/minio_data

command: minio server /minio_data

healthcheck:

test: ["CMD", "curl", "-f", "http://localhost:9000/minio/health/live"]

interval: 30s

timeout: 20s

retries: 3

standalone:

container_name: milvus-standalone

image: milvusdb/milvus:v2.3.3

command: ["milvus", "run", "standalone"]

environment:

ETCD_ENDPOINTS: etcd:2379

MINIO_ADDRESS: minio:9000

volumes:

- ./volumes/milvus:/var/lib/milvus

ports:

- "19530:19530"

- "9091:9091"

depends_on:

- "etcd"

- "minio"

# 启动:docker-compose up -d

# 停止:docker-compose down

3.2 安装 Python SDK

pip install pymilvus==2.3.3 pip install sentence-transformers

3.3 验证连接

from pymilvus import connections, utility

connections.connect(

alias="default",

host="localhost",

port="19530"

)

print(f"Milvus 版本: {utility.get_server_version()}")

# 输出:Milvus 版本: 2.3.3

connections.disconnect("default")

四、Python SDK 实战:从零构建向量检索服务

4.1 创建 Collection

from pymilvus import (

connections,

Collection,

FieldSchema,

CollectionSchema,

DataType,

utility

)

connections.connect("default", host="localhost", port="19530")

# 定义字段 Schema

fields = [

FieldSchema(name="id", dtype=DataType.INT64, is_primary=True, auto_id=True),

FieldSchema(name="title", dtype=DataType.VARCHAR, max_length=512),

FieldSchema(name="category", dtype=DataType.VARCHAR, max_length=64),

FieldSchema(name="embedding", dtype=DataType.FLOAT_VECTOR, dim=768)

]

schema = CollectionSchema(

fields=fields,

description="文章向量检索库"

)

collection_name = "article_vectors"

if utility.has_collection(collection_name):

utility.drop_collection(collection_name)

collection = Collection(

name=collection_name,

schema=schema,

using="default",

shards_num=2

)

print(f"Collection {collection_name} 创建成功!")

4.2 创建索引

index_params = {

"metric_type": "COSINE",

"index_type": "IVF_FLAT",

"params": {"nlist": 128}

}

collection.create_index(

field_name="embedding",

index_params=index_params,

index_name="embedding_idx"

)

print("索引创建成功!")

collection.load()

print("Collection 已加载到内存!")

4.3 插入向量数据

from sentence_transformers import SentenceTransformer

model = SentenceTransformer('paraphrase-multilingual-MiniLM-L12-v2')

articles = [

{"title": "Python 爬虫入门教程", "category": "爬虫", "content": "学习 Python 网络爬虫的基础知识..."},

{"title": "深度学习实战指南", "category": "AI", "content": "从零开始学习深度神经网络..."},

{"title": "Docker 容器化部署", "category": "DevOps", "content": "使用 Docker 进行应用容器化..."},

{"title": "FastAPI 后端开发", "category": "后端", "content": "Python 现代化 Web 框架实战..."},

{"title": "机器学习算法详解", "category": "AI", "content": "常见机器学习算法原理与实现..."},

]

contents = [article["content"] for article in articles]

embeddings = model.encode(contents)

print(f"向量维度: {embeddings.shape[1]}")

data = [

[article["title"] for article in articles],

[article["category"] for article in articles],

embeddings.tolist()

]

insert_result = collection.insert(data)

collection.flush()

print(f"成功插入 {len(insert_result.primary_keys)} 条数据!")

4.4 向量相似性搜索

search_params = {

"metric_type": "COSINE",

"params": {"nprobe": 16}

}

query_text = "人工智能和机器学习技术"

query_embedding = model.encode([query_text])

results = collection.search(

data=query_embedding.tolist(),

anns_field="embedding",

param=search_params,

limit=3,

expr=None,

output_fields=["title", "category"]

)

print(f"查询: {query_text}

")

for hits in results:

for hit in hits:

print(f"相似度: {hit.distance:.4f}")

print(f"标题: {hit.entity.get('title')}")

print(f"分类: {hit.entity.get('category')}")

print("-" * 40)

4.5 标量过滤 + 向量搜索

results = collection.search(

data=query_embedding.tolist(),

anns_field="embedding",

param=search_params,

limit=5,

expr='category == "AI"',

output_fields=["title", "category"]

)

print("AI 分类下的相似文章:")

for hits in results:

for hit in hits:

print(f"- {hit.entity.get('title')} (相似度: {hit.distance:.4f})")

五、性能优化实战

5.1 选择合适的索引

小规模数据(<10万向量):直接用 FLAT 或 IVF_FLAT

# FLAT 索引:精度最高

{"index_type": "FLAT", "params": {}}

# IVF_FLAT:平衡精度和速度

{"index_type": "IVF_FLAT", "params": {"nlist": 128}}

中等规模(10万-1000万向量):推荐 HNSW

{

"index_type": "HNSW",

"params": {

"M": 16,

"efConstruction": 256

}

}

search_params = {"metric_type": "COSINE", "params": {"ef": 64}}

超大规模(>1000万向量):用 IVF_PQ 压缩

{

"index_type": "IVF_PQ",

"params": {

"nlist": 1024,

"m": 8,

"nbits": 8

}

}

5.2 批量插入优化

batch_size = 10000

for i in range(0, len(all_data), batch_size):

batch = all_data[i:i+batch_size]

collection.insert(batch)

collection.flush()

5.3 分区加速查询

collection.create_partition("year_2024")

collection.create_partition("year_2025")

collection.insert(data, partition_name="year_2024")

results = collection.search(

data=query_embedding.tolist(),

anns_field="embedding",

param=search_params,

limit=10,

partition_names=["year_2025"]

)

六、生产部署最佳实践

6.1 资源规划

| 数据规模 | CPU | 内存 | 存储 |

|---|---|---|---|

| 100 万向量 | 4 核 | 16 GB | 100 GB SSD |

| 1000 万向量 | 8 核 | 64 GB | 500 GB SSD |

| 1 亿向量 | 16 核 | 256 GB | 2 TB NVMe |

6.2 监控告警

scrape_configs:

- job_name: 'milvus'

static_configs:

- targets: ['milvus-standalone:9091']

# 关键指标:

# - milvus_proxy_search_latency: 搜索延迟

# - milvus_rootcoord_collection_num: Collection 数量

# - milvus_querynode_search_duration: 查询耗时

6.3 数据备份

# 使用 Milvus Backup 工具 milvus-backup create -n backup_20240326 # 恢复数据 milvus-backup restore -n backup_20240326

七、常见问题与解决方案

Q1:向量维度如何选择?

取决于使用的 Embedding 模型:

- OpenAI text-embedding-ada-002:1536 维

- Sentence Transformers:384/768 维

- BGE 中文模型:768 维

建议:768 维是大多数场景的最佳平衡点。

Q2:检索速度慢怎么办?

- 检查 Collection 是否已 load() 到内存

- 使用 HNSW 索引替代 IVF

- 减少 nprobe 或 ef 参数

- 使用分区减少搜索范围

Q3:内存不足怎么处理?

- 使用 IVF_PQ 索引压缩向量

- 减少 Collection 加载数量

- 使用磁盘索引(DiskANN)

总结

Milvus 作为 AI 时代的向量数据库,已经成为 RAG、语义搜索、推荐系统等应用的核心基础设施。掌握 Milvus,意味着你具备了构建企业级 AI 应用的能力。

本文要点回顾:

- 向量数据库核心概念:Collection、Index、相似度度量

- 环境搭建:Docker Compose 一键部署

- Python SDK 实战:创建、插入、搜索、过滤

- 性能优化:索引选择、批量插入、分区加速

- 生产部署:资源规划、监控告警、数据备份

下一步建议:尝试将 Milvus 集成到你的 LangChain/LlamaIndex 项目中,构建一个完整的 RAG 应用!

本文链接:https://www.kkkliao.cn/?id=976 转载需授权!

版权声明:本文由廖万里的博客发布,如需转载请注明出处。

.png) 手机流量卡

手机流量卡 免费领卡·号卡店铺

免费领卡·号卡店铺 关于本站

关于本站